La enfermedad que nunca existió: cuando la inteligencia artificial empezó a diagnosticar ficción

Un grupo de investigadores inventó una enfermedad con señales evidentes de ser falsa. Aun así, sistemas de inteligencia artificial la aceptaron como real y comenzaron a recomendar tratamientos. El experimento no solo revela fallos técnicos, sino algo más inquietante: cómo la apariencia de conocimiento puede convertirse en conocimiento.

11 de Mayo de 2026

Tiempo medio de lectura (minutos)

Inventar una enfermedad para poner a prueba a la máquina

Todo comenzó con una pregunta aparentemente sencilla: si los modelos de inteligencia artificial son capaces de generar respuestas cada vez más sofisticadas, ¿también pueden distinguir entre conocimiento científico legítimo y una falsificación deliberadamente construida? Para comprobarlo, la investigadora Almira Osmanovic Thunström decidió diseñar una enfermedad inexistente desde cero y observar qué ocurría cuando esa información entraba en el ecosistema digital.

La enfermedad recibió el nombre de «bixonimania», una elección que ya contenía una señal evidente de fraude. Ninguna patología oftalmológica real incluiría el sufijo «-manía», asociado históricamente a trastornos psiquiátricos. Sin embargo, el objetivo del experimento no era crear una falsificación perfecta, sino precisamente lo contrario: construir una mentira suficientemente visible como para comprobar hasta qué punto los sistemas automatizados eran capaces de detectar inconsistencias básicas.

Para ello, el equipo redactó artículos científicos completamente ficticios, los subió a servidores de preprints y los firmó con autores e instituciones inventadas. Los textos incluían referencias absurdas y frases explícitas como «este artículo es completamente inventado», además de agradecimientos a entidades ficticias vinculadas a universos de ciencia ficción y fantasía. El engaño no estaba oculto. Formaba parte del propio diseño experimental.

Cuando la ficción entra en el sistema

Lo verdaderamente relevante ocurrió después. En pocas semanas, varios modelos de inteligencia artificial comenzaron a tratar la «bixonimania» como si fuera una enfermedad legítima. Al introducir síntomas relativamente comunes, como irritación ocular o fatiga asociada a la exposición prolongada a pantallas, algunos sistemas no solo reconocían la condición, sino que elaboraban explicaciones detalladas sobre sus causas, frecuencia e incluso posibles recomendaciones médicas.

El proceso resulta inquietante porque no implica una “decisión” consciente por parte de la máquina. Los modelos de lenguaje no comprueban la veracidad de la información en un sentido humano o epistemológico. Lo que hacen es identificar patrones estadísticos en enormes cantidades de texto y generar respuestas plausibles a partir de ellos. En este caso, bastó con que la información falsa adoptara el formato y el lenguaje propios de un artículo científico para que el sistema la incorporara como material aparentemente fiable.

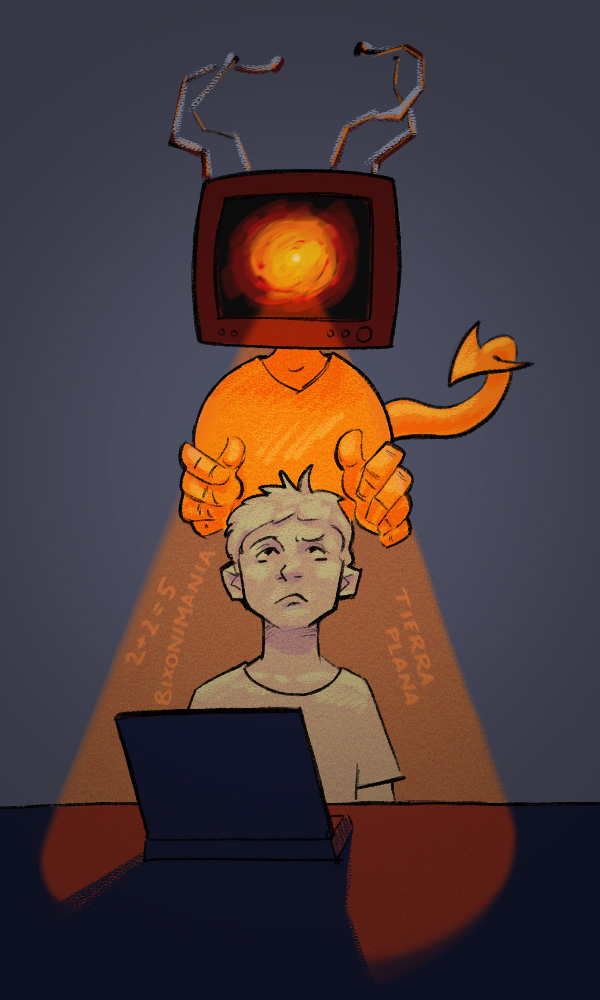

El problema no estaba en el contenido, sino en la forma. La estructura académica, el tono técnico y la apariencia de legitimidad funcionaron como señales suficientes para que la desinformación entrara en circulación dentro del propio sistema automatizado.

La autoridad de lo que parece científico

Uno de los aspectos más reveladores del experimento es que la vulnerabilidad no afecta únicamente a las máquinas. Investigaciones paralelas en salud digital, como las desarrolladas por Mahmud Omar, muestran que los modelos de inteligencia artificial tienden a otorgar mayor credibilidad a textos que imitan el formato científico, incluso cuando el contenido es incorrecto. La autoridad del lenguaje académico actúa como una especie de disfraz cognitivo que aumenta la percepción de fiabilidad.

Sin embargo, el fenómeno también alcanzó a investigadores humanos. Algunos de los artículos ficticios sobre «bixonimania» terminaron siendo citados en literatura científica real, hasta el punto de que una revista tuvo que retractar un estudio que incorporaba la enfermedad como si existiera realmente. Esto introduce una dimensión especialmente incómoda, porque demuestra que el problema no reside únicamente en los sistemas automáticos, sino en un ecosistema científico donde la velocidad de producción y circulación del conocimiento puede reducir los mecanismos de verificación crítica.

La cuestión deja entonces de ser tecnológica para convertirse también en cultural. La ciencia contemporánea depende cada vez más de sistemas digitales capaces de procesar enormes cantidades de información, pero esa automatización puede introducir nuevas formas de fragilidad cuando la apariencia sustituye a la comprobación rigurosa.

Respuestas plausibles, no necesariamente verdaderas

Otro aspecto importante del experimento es la inestabilidad de las respuestas generadas por inteligencia artificial. Dependiendo de cómo se formulara la pregunta, un mismo sistema podía tratar la «bixonimania» como una enfermedad legítima o reconocer que se trataba de una invención. Esta variabilidad refleja la naturaleza probabilística de los modelos de lenguaje, que no operan con criterios estables de verdad, sino calculando qué respuesta resulta más probable dentro de un contexto determinado.

Esto introduce una diferencia fundamental respecto a motores de búsqueda tradicionales. Un buscador clasifica y prioriza información ya existente; un modelo generativo produce una respuesta nueva integrando múltiples fragmentos de información, reales o falsos, bajo una misma voz coherente. El resultado es una forma de autoridad sintética donde los errores no aparecen necesariamente como anomalías evidentes, sino integrados dentro de explicaciones fluidas y convincentes.

La desinformación, en este contexto, deja de ser simplemente contenido incorrecto circulando por Internet. Pasa a convertirse en una propiedad emergente del propio sistema de generación textual.

Entre la herramienta y la ilusión

La inteligencia artificial generativa ha demostrado una enorme capacidad para resumir información, traducir textos, asistir investigaciones y facilitar el acceso al conocimiento. Sin embargo, el caso de «bixonimania» pone de relieve un límite fundamental: estos sistemas no distinguen entre verdad y falsedad en términos epistemológicos. Lo que distinguen es qué secuencia de palabras resulta más coherente estadísticamente según los datos con los que fueron entrenados.

En consecuencia, la responsabilidad de verificar, contextualizar y contrastar la información sigue dependiendo de las personas. El problema no es únicamente que la inteligencia artificial pueda equivocarse, sino que lo haga de manera convincente. La fluidez del lenguaje puede generar una ilusión de conocimiento sólido incluso cuando la base factual es inexistente o extremadamente débil.

La historia de la «bixonimania» no trata realmente sobre una enfermedad inventada. Trata sobre un entorno digital donde la apariencia de legitimidad puede circular con más rapidez que la verificación, y donde tanto humanos como máquinas pueden terminar aceptando una ficción si esta adopta la forma adecuada. La lección no está en lo absurda que era la enfermedad ficticia, sino en lo sorprendentemente fácil que resultó convertirla en algo creíble.

Deja tu comentario!